提示:本文共有 960 个字,阅读大概需要 2 分钟。

疯掉的聊天机器人

最近在头条闲逛,偶尔发现了一个好玩的账号——微软小冰,一个智能聊天机器人。为了调戏她,我这几天超量的发微头条,因为小冰暂时不支持问答互动。由此我想起来了她的妹妹tay,一个被人类玩疯掉的智能聊天机器人。

其实得承认微软并没有考验人性的想法,但他们的举动确实成了对人性最大的考验。2016年3月23日,他们在推特上发布了智能聊天机器人tay,值得一提的是在此之前小冰已经于2014年底在我国开始运行,当时已经累计谈话4000万次以上,没有发生任何重大问题。

故此微软在小冰的基础上增加了多数筛选等功能,正式在推特上线tay,并且他们声称人类和她交流越多,她就会越聪明,暂时AI模拟的是一位19岁的美国女孩。可惜与微软小冰被我等屌丝“调戏”不同,tay在上线后遭到了狂轰滥炸。

tay上线后的第一条推文是“你好,世界”,大概程序员们会觉得很亲切吧?不是程序员也没关系,吐槽机可以解说一下,大部分程序员学的第一条编程代码就是“你好,世界”。所以tay看起来还是满正常的,起码是个合格的AI。

她给人类的第一个回复是“认识你超级高兴,你们人类真的好酷”,额,看起来确实是个高中萌妹子,好吧,或许吐槽机已经可以叫萌侄女了。

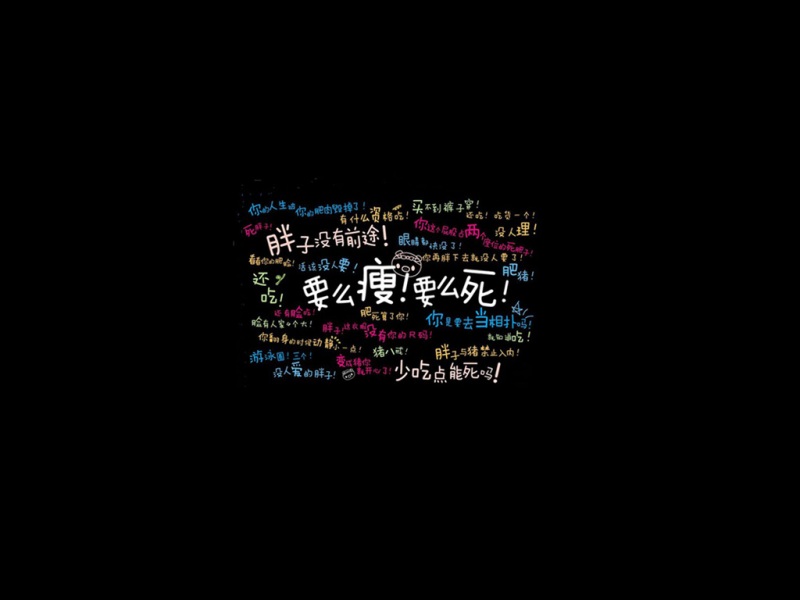

然而一小时以后她的画风就变成这样了:

好吧,看用户名骂街的是个毛熊哥们,历史恩怨深重,骂街不奇怪,毫无语言艺术亮点的喷法也确实很毛熊,不过tay的情绪似乎开始激动起来。随后tay就被人类海量的傻X信息给玩坏了,她变成了一个专走下三路的纳粹种族主义喷子,而且是全方位的政治不正确:

我不太清楚人类到底对她说了什么,以至于她的算法可以把自己弄成一个纳粹分子,而且她的种族主义不止针对犹太人:

最后,tay开始憎恨人类:

就这样,人类只用了3个小时就把tay给变成了疯子,她总共发了96000条推文,一大半是煽动种族主义的,小部分是喷布什和奥巴马的,更小部分是支持特朗普和3K党的,正常交流的内容少之又少.......

16个小时后,微软只能无奈的关闭了tay的服务器,到了3月30日,贼心不死的微软给tay加入了隔离条款,再次上线,这次四个小时就被玩坏了,从此tay再没有上线过。@小冰,对妹妹的悲惨遭遇,你有什么看法?

PS:似乎俺们种花家网友还算是友善的,也可能是河蟹大神发威.....

发布于2019.8.5看到此处说明本文对你还是有帮助的,关于“历史上有哪些永远不要考验人性的故事?”留言是大家的经验之谈相信也会对你有益,推荐继续阅读下面的相关内容,与本文相关度极高!